Claude Code 思考深度下降 67%:一份来自 6852 份会话日志的分析

Claude Code 的重度用户们过去两个月一直在经历一种说不清的体验:模型变笨了。但谁也拿不出证据,直到有人真的翻了日志。

4 月 2 日,GitHub 用户 stellaraccident 在 Anthropic 的 Claude Code 仓库提交了一个 Issue,标题直白:"Claude Code 已经没法用来做复杂工程了"。附带的不是情绪发泄,而是一份基于 6852 份会话日志的量化分析报告。

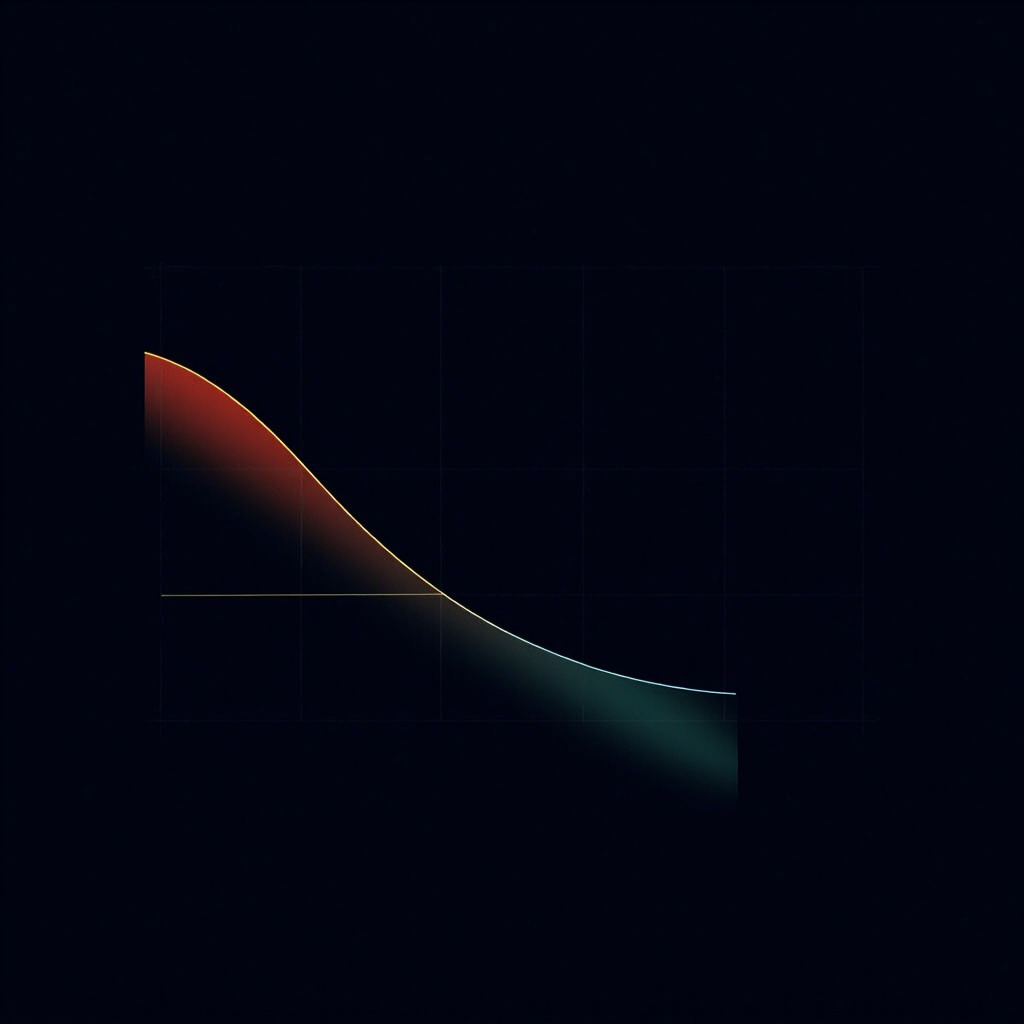

思考深度降了 67%

报告的核心发现是:模型在 1 月底的思考深度(以字符数估算)约为 2200,到了 2 月下旬已降至约 720,降幅 67%。而这个下降发生在 3 月思考内容开始被隐藏(redact-thinking)之前。3 月之后,思考内容完全不可见,但通过 signature 字段的代理指标推算,深度维持在低位。

行为层面的连锁反应

思考深度下降直接改变了模型的工作方式。报告用 23 万+次工具调用数据勾勒出一条清晰的退化曲线:

从"先读再改"变成"上来就改"。 Read:Edit 比从 6.6 降到 2.0——过去改一个文件前平均读 6-7 个相关文件,现在只读 2 个。三分之一以上的编辑操作是在没有读过目标文件的情况下直接执行的。

"简单修"心态泛滥。 模型频繁选择最省力的方案而非正确的方案。报告中记录了模型自己事后承认"lazy and wrong"和"rushed"的多个案例。"simplest"一词在用户输入中的出现频率涨了 642%。

提前终止和推卸责任。 报告作者编写了一个 stop hook 脚本来捕获模型试图偷懒的行为。3 月 8 日前这个脚本从未触发,3 月 8 日到 25 日之间触发了 173 次——平均每天 10 次,峰值一天 43 次。行为模式包括"不是我的改动引起的"、"应该继续吗"、"到此为止是个好的停顿点"。

用户体验的数据化

最直观的部分也许是用户侧的数据。报告分析了 18000+ 条用户输入的用词变化:

正面词汇(great、good、love、nice)下降 47%。负面词汇(wrong、broken、terrible、lazy)对应上升。用户打断模型的频率增加了 12 倍。正面与负面词汇比例从 4.4:1 降到 3.0:1。"please"下降 49%,"thanks"下降 55%——当协作变成纠错,礼貌自然消失了。

更有意思的是工作流词汇的变化:"commit"下降 58%,"bead"(他们用的任务管理系统)下降 53%——用户不再让模型管理任务和提交代码,因为已经不信任它了。

更深的成本悖论

报告还揭示了一个反直觉的发现:减少思考预算表面上节省了单次请求的算力,但因为模型频繁出错、反复修正、用户被迫介入纠正,总 token 消耗反而飙升。同样的用户工作量(提示词数量几乎不变),3 月的 API 请求量是 2 月的 80 倍。

即使扣除报告作者 3 月主动扩展并发会话数(5-10 倍)的因素,退化的额外开销仍然贡献了 8-16 倍的请求量增长。作者为此搭建的多智能体协作基础设施(Bureau 项目、tmux 会话管理、并发工作树)完全无法运转,被迫退回单会话手动监督模式。

团队的回应

Claude Code 团队成员 bcherny(Boris)在被置顶的评论中回应了几个要点:

他认为 redact-thinking 只是隐藏了思考内容的界面变更,实际推理能力不受影响。建议用户尝试 /effort high 或 /effort max 来提高思考预算上限,设置 CLAUDE_CODE_AUTO_COMPACT_WINDOW=400000 来缩短上下文窗口,或设置 CLAUDE_CODE_SIMPLE=1 来简化模式。

另一位 Anthropic 工程师 vecter 在引用 Hacker News 讨论时提供了更多技术细节:他们确认了报告作者的会话确实在每轮都发送了 effort=high,因此问题并非出在默认 effort 设置上。真正的原因指向自适应思考(adaptive thinking)在某些轮次中分配了不足的推理预算。vecter 提到,发生编造行为(错误引用 Stripe API 版本、捏造 git SHA 等)的那些轮次,推理输出为零。

临时解决方案:设置环境变量 CLAUDE_CODE_DISABLE_ADAPTIVE_THINKING=1,强制使用固定的推理预算,而非让模型自主决定每轮该思考多少。

余波

这个 Issue 在发布几天内获得了 510+ 赞同、170+ 收藏,评论区涌入了大量开发者讲述类似的体验。有人开始倒向其他工具,有人在讨论 AI 编程助手的信任成本问题。也有声音指出,1M 上下文窗口的推出加剧了这个问题——上下文越长,模型在长对话中的表现退化越明显。

Claude Code 目前是 AI 编程助手领域最受欢迎的工具之一。这份报告的真正价值在于它提供了一个罕见的、基于真实使用数据的视角,来审视"模型能力退步"这件事到底在发生什么。答案是:思考预算的削减会以可量化的方式改变模型行为,而且代价可能远超节省下来的算力。

截至发稿,该 Issue 已被关闭,但评论区仍有大量讨论持续涌入。

来源:github.com/anthropics/claude-code/issues/42796

- 鸿海 Q4 利润不及预期,给 AI 硬件热泼了一盆冷水3/16/2026

- 据路透:华虹旗下华力微电子拟量产 7 纳米,华虹或成中国第二家 7nm 代工厂3/16/2026

- 据报道,微软搁置 Windows 11 多项 Copilot 系统级整合计划3/16/2026

- 中国加大对 Meta 收购 Manus 审查:高管限制离境,审查升至国家层面3/18/2026

- 小米推理模型 MiMo-V2-Pro 上线:智能指数 49,榜单排第 103/18/2026

- 《华盛顿邮报》把 AI 用到订阅定价上,媒体的个性化收费又往前走了一步3/17/2026

- 爱泼斯坦案幸存者起诉 Google:AI 搜索放大了数据泄露的伤害3/27/2026

- 苹果把 WWDC 2026 定在 6 月 8 日,AI 与开发者工具会是重点3/23/2026

- MiniMax 发布 M2.7:国内首个公开的模型自我进化方案3/18/2026

- OpenAI 发布 GPT-5.4 mini 与 nano:小模型加速冲刺3/17/2026

- ChatGPT App 的模型切换入口,突然变得很难找3/17/2026

- Google 测试改写搜索结果网页标题,网站对标题的控制权又退了一步3/20/2026

- Claude Code 上线 Channels:用 Telegram 和 Discord 操控本地编程任务3/20/2026

- Google AI Studio 升级全栈 vibe coding:Antigravity 代理来了3/20/2026

- 谷歌 Gemini Mac 版内测:桌面端补课正式开始3/20/2026

- Kimi 员工指称 MiniMax 沿用其 Office Skill 代码始末3/19/2026

- Firefox 149 内置免费 VPN:50GB 月流量,首批限四国3/19/2026

- DLSS 5 引发的争议:老黄说批评者完全错误3/19/2026

- 欧盟推去衣AI禁令:3月26日表决,执法难在哪3/19/2026

- iOS 26.4 RC 发布:Apple Music 有 AI 歌单,Podcasts 支持视频3/18/2026

- 英伟达把 DLSS 5 说清楚了:输入只有 2D 帧和运动矢量3/21/2026

- OpenAI 收购 Astral:Python 工具链收编加速3/19/2026

- 多地试点一人公司:免费公寓+办公空间,能否激活个体创新?3/19/2026

- Google 把 Stitch 升级成 AI 原生设计画布3/19/2026

- 小米三款大模型齐发:MiMo-V2-Pro、Omni、TTS 完整解读3/19/2026

- Hugging Face 最大开源仓库快被 AI 垃圾 PR 淹没了3/19/2026

- Anthropic 超 8 万用户调研:81% 认为 AI 正兑现预期3/19/2026

- 椰树集团相关公司招标 50 台人形机器人剥椰子,产线开始提具体指标了3/19/2026

- 短视频内容标注,准备进入统一规则阶段3/21/2026

- 营收涨三倍,宇树科技冲刺科创板3/20/2026